Ingannare un’Intelligenza artificiale? È più facile del previsto

26 July 2018 | Scritto da La redazione

A lanciare l’allarme è l’International Conference on Machine Learning, secondo cui i sistemi di intelligenza artificiale potrebbero diventare facilmente preda di una nuova generazione di hacker.

Distinguere una tartaruga da un fucile, o una tazzina di caffè da una palla da baseball stampata in 3D non dovrebbe essere una cosa complicata, specialmente per i sofisticati sistemi di Intelligenza artificiale che stanno entrando in misura sempre maggiore nelle nostre vite. Ma a quanto pare disorientare un’IA è più facile del previsto e una nuova generazione di hacker potrebbe mettere in discussione la sicurezza di questa tecnologia.

A sostenerlo, come riferisce la rivista Science, è ICML, International Conference on Machine Learning, che ha lanciato un allarme a tutta la comunità scientifica che si occupa di Intelligenza artificiale. È emerso, per esempio, che basta alterare un’immagine, anche apportando modifiche minime, per “confondere” l’IA, che potrebbe non riconoscere più quello che vede o addirittura scambiarlo per altro. E questo non vale solo per le immagini, ma anche per i suoni e gli oggetti tridimensionali.

Alcuni gruppi di ricerca hanno già iniziato a correre ai ripari: tra questi il Massachusetts Institute of Technology che, oltre a sottoporre l’IA ad alcuni test, sta provando a mettere a punto delle contromisure.

Come manipolare un’IA? Ci sono molti modi e per alcuni di questi non serve certo essere un hacker informatico o un esperto programmatore. Per confondere l’Intelligenza artificiale di un’auto a guida autonoma, per esempio, è sufficiente avere a disposizione qualche adesivo: lo scorso anno due team di ricercatori delle università di Berkeley e Washington, hanno applicato alcuni adesivi su dei segnali stradali, ingannando così la vettura che ha scambiato il cartello di “stop” con un limite di velocità.

Più complessa, ma comunque di facile comprensione, la tecnica messa a punto da un gruppo di ricercatori del MIT: il team, guidato da Anish Athalye, ha realizzato un software capace di ingannare i sistemi di riconoscimento delle immagini sfruttando una tipologia di attacco informatico nota come adversarial example. Attraverso un software l’immagine originale viene alterata un pixel alla volta e sottoposta al sistema di riconoscimento per essere classificata dopo ogni singola modifica. Ciascun cambiamento, però, è minimo rispetto alla versione precedente e quindi il sistema di intelligenza artificiale continua a classificare l’immagine come analoga a quella di partenza, anche quando, dopo migliaia di piccole variazioni, il contenuto è completamente diverso. Questa tecnica, come detto, era già nota ma grazie al software sviluppato dai ricercatori del MIT può essere applicata in modo molto più veloce ed efficace.

Cambiare la prospettiva. “Abbiamo bisogno di ripensare completamente la nostra concezione di apprendimento automatico per renderlo più sicuro”. È quanto dichiarato da Aleksander Madry del Mit e questa strada è stata seguita anche da altri ricercatori ed esperti di IA in giro per il mondo.

Questi attacchi ai sistemi di Intelligenza artificiale, infatti, possono risultare fondamentali per rivelare nuovi meccanismi d’azione delle reti neurali e per comprendere a pieno il funzionamento dell’apprendimento automatico. Individuare e affrontare i rischi è l’unico modo per prevederli e scongiurarli.

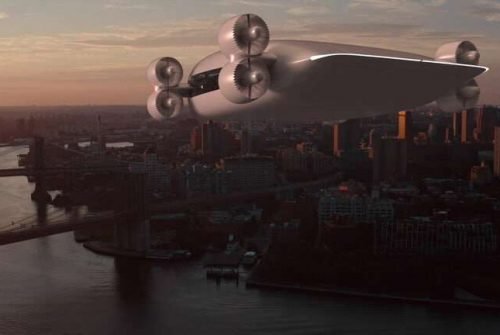

L’Intelligenza artificiale si sta evolvendo a gran velocità e anche le sue applicazioni nella vita di tutti i giorni sono sempre maggiori. Ma prima che a questi sistemi vengano affidati compiti delicati e a diretto contatto con l’uomo (come per esempio la guida di un’auto o di un mezzo pubblico) è necessario renderli meno vulnerabili.