Facebook sta utilizzando l’AI per risolvere parte dei suoi problemi: ecco come

8 November 2018 | Scritto da Filippo Scorza

La sicurezza di Facebook in fatto di fake news e materiale inappropriato in passato non si è dimostrata all’altezza della situazione: l’Intelligenza artificiale potrebbe aiutare il colosso a proteggere i suoi utenti.

Quando si parla di Intelligenza artificiale e machine learning, si ha spesso la sensazione che tali concetti vengano percepiti come destinati a un lontano futuro: forse non abbiamo la consapevolezza di quello che stanno facendo gli algoritmi predittivi e decisionali perché non sono concretamente tangibili.

Leggiamo contenuti in rete, guardiamo qualche serie televisiva o assistiamo a qualche intervento e presentazione, ma forse dovremmo fermarci a riflettere su quello che tali tecnologie fanno quotidianamente per noi.

Un algoritmo di machine learning, come ben sappiamo, ha necessità di grandi moli di dati per poter “apprendere” e generare un set di informazioni del contesto in cui opera; al tempo stesso sappiamo che piattaforme quali Facebook, Twitter e Google non hanno certo che l’imbarazzo della scelta a tal riguardo.

Mark Zuckerberg, ormai sotto accusa da tempo, è stato costretto a far fronte ad ondate di troll, fake account, bot, contenuti non appropriati e molteplici problematiche quali fishing e sicurezza informatica.

A caccia di bot

I criminali informatici impiegano bot che agiscono come sciami quando si tratta di creare account su Facebook: utilizzano indirizzi IP falsi, rallentano e accelerano il loro ritmo di digitazione per farlo corrispondere a quello di un essere umano e si aggiungono l’un l’altro come reali amici digitali.

Ma non hanno ancora capito come simulare il movimento della nostra mano quando impugniamo lo smartphone!

Proprio su tale aspetto si concentra l’AI di una startup Israeliana: Unbotify.

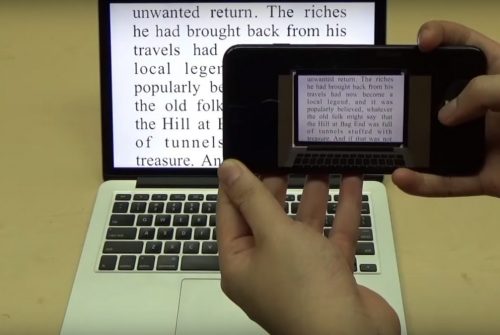

Unbotify funziona comprendendo i dati comportamentali sui dispositivi, come la velocità di movimento del telefono quando si crea un account mediante l’analisi dei dati prodotti dal giroscopio.

Il suo algoritmo riconosce questi modelli perché è stato addestrato su migliaia di utenti che hanno digitato, “tappato” e swippato sui loro device centinaia di volte.

I bot possono falsificare gli indirizzi IP, ma non possono simulare il “come” una persona interagisce fisicamente con un dispositivo.

Così facendo Facebook ha annunciato a maggio di aver cancellato 583 milioni di account falsi nei primi tre mesi del 2018, in pratica mezzo miliardo di utenti fasulli.

Ma non è finita qui: vi ricordate i meme?

Ebbene, nel mese di marzo, il social network ha detto che stava espandendo il suo programma di controllo delle notizie per includere immagini e video dopo che una nuova forma di propaganda ha iniziato a utilizzare meme anzichè fake news testuali per influenzare il pensiero degli utenti, attraverso la manipolazione di immagini e video.

Questi strumenti di controllo delle notizie stanno utilizzando l’AI di AdVerif.ai: questo strumento è in grado di trovare immagini discriminatorie e che non rispettato i terms and condition di Facebook. È

poi in grado di fare una ricerca inversa dell’immagine per vedere in quali altri contesti sia stata pubblicata e se è stata alterata per mostrare qualcosa di diverso.

In pratica è in grado di dirci se un’immagine sia stata manipolata oppure no.

Questa immagine, pubblicata dalla pagina Facebook di “Vets for Trump” il 28 settembre 2017, è stata modificata digitalmente, ma offerta come autentica.

L’originale è stata scattata dal fotografo di Seattle Seahawks Rod Mar, e ha mostrato il giocatore della NFL Michael Bennett che si esibisce nella ormai tradizionale “danza post-vittoria” negli spogliatoi Seahawks.

L’immagine fake, meme, lo mostra invece mentre impugna una bandiera americana data in fiamme e postata sulla pagina sopra citata causando non poche polemiche attorno al giocatore raggiungendo oltre 10.000 condivisioni, like, commenti e views.

Il mondo digitale che stiamo creando, a quanto pare, ha bisogno non solo di regole e limiti ben definiti ma anche di garanti umani e/o artificiali in grado di controllare notizie contraffatte, diffusione di contenuti offensivi, violenti e non appropriati: serviranno leggi e punizioni più severe anche nel web?

O forse il problema non sono più le foto fake ma il fatto che alla gente non importi che non siano reali?